『Adobe MAX』って、どんなイベント?

今回は11月16日に東京ビッグサイトの南展示棟で開催された。チケットは2万円(超早割1万円、学生3000円)と安くはないイベントだが、3600人が参加し大盛況だった。

ご存知のように、アドビのアプリケーションはクリエイティブの世界では、なくてはならないもの。写真加工のPhotoshop、ロゴやイラスト、印刷物のデザインに使うIllustrator、動画編集に使うPremiere Proをはじめ、ありとあらゆるクリエイティブに使うアプリケーションを備えており、それが月額6480円のサブスクリプションで使える……ということで、市場で圧倒的な強みを見せている。

Adobe MAX Japanは、そのユーザーを集めて開催されるイベントで、多数のユーザーが集まり、新機能や活用テクニックについて話を聞いたり、ユーザー同士が交流したりする。

なんといっても注目はAdobe流の生成AI『Adobe Firefly』

今年のAdobe MAX Japanの注目は、なんといってもアドビの生成AI、Adobe Fireflyの活用がより実際的に広範囲になったことだろう。

ちなみに、以前からアドビはAdobe Senseiという名称でAIを活用していたが(ちなみに、このSenseiという名称については、日本側はあまり賛成ではなかったそうだが、US側が語感を気に入って付けたらしい)、生成AI技術の進化とともに、それを取り入れたAdobe Fireflyの活用を今年の3月に発表。以降、Adobe Fireflyを活用した新機能を次々と発表している。

生成AI技術の利用によって、大きく分けて2つのメリットが得られている。

ひとつは、これまで不可能だったような難易度が高い処理が可能になったこと。もうひとつは、これまでなら非常に難しく技術的に複雑だったことが、容易にできるようになったこと。

Adobeの生成AIも、他の多くの生成AIと同じく、不確実な生成をすることもあるが、それが生かせるような場面であれば積極的に活かそうとする姿勢が特徴的。クリエイティブに関して多くの知見があり、クリエイティビティというものに関して自覚的であるところが、Adobeの生成AI利用の特徴的な部分だ。

また、実際に活用される場面において、著作権的に問題がないように最初から配慮されており、Adobe StockのAdobeが権利を保有している写真から学習したり、どの画像が影響を及ぼしているかをトレースしたりできるようになっている。だから、安心して、クリエイティブワークに利用できるのだ。

Adobe流生成AI『Adobe Firefly』は、なぜクリエイティブワークに使えるのか?

一般的に生成AIの画像は、ある程度ディレクションできるが、ユーザーの細い意図を100%反映するのは難しい。SNSでシェアして楽しんだり、アイデア出しレベルでは使えても、厳密に仕上がりを追求する必要のあるプロのクリエイティブには使うのは難しいと感じている人が多かったと思う。

しかし、Adobe Fireflyの場合は、

・もともとある画像の重要でない欠損部分を埋め合わせるために使う

・ランダムに近い生成だったとしても、Adobe CCアプリで最終的に仕上げられる

・既存の制作物を『スタイル』として、次の制作物に適用できる

など、実際のクリエイターの制作支援として使う方法を模索している。

生成AIをどのように使うかは、Microsoft、Amazon、Google、アップルなど、それぞれの企業の立場と姿勢がよく表われるところだと思うが、Adobeの生成AIの活用方法も、またアドビの姿勢をよく表しているといえる。

Adobe MAX Japan 2023の注目トピック

最後に、Adobe MAX 2023で発表された内容を簡単に説明しておこう。

まず、画像生成に大きく役立ちそうなAdobe Fireflyは早くも2世代目となり『Adobe Firefly Image 2 Model』となった。ユーザー指定のカスタムスタイルを適用できる『生成マッチ』など、よりユーザーの制作したいスタイルに生成物を着地する方法がいくつか用意されている。また、これにともないベータ版での提供が終了し、一般提供が開始された。

Premiere Proの『文字起こしベースの編集』と『フィラーワードの検出』の機能の実演もすごかった。

まず、インタビュー動画から、一括して文字起こしをする。そして、『フィラーワードの検出』を行うと、「えー」とか「あー」とかいうフィラーワード(筆者もつい発してしまうが、これがあると動画が急にシロウトっぽくなるのだ)を検出し、一括削除することができる。また、話すことを考えている無音のすき間も「○秒以下」と設定して削除することができる。いわば、ほぼ自動で『ジェットカット』(Ⓒジェットダイスケ)することができるのだ。

さらに、テキスト側で段落を削除したり、入れ替えたりすることで、動画側も削除したり入れ替えたりすることができるのだ。これはインタビュー動画ではとても便利な編集機能だと思う。

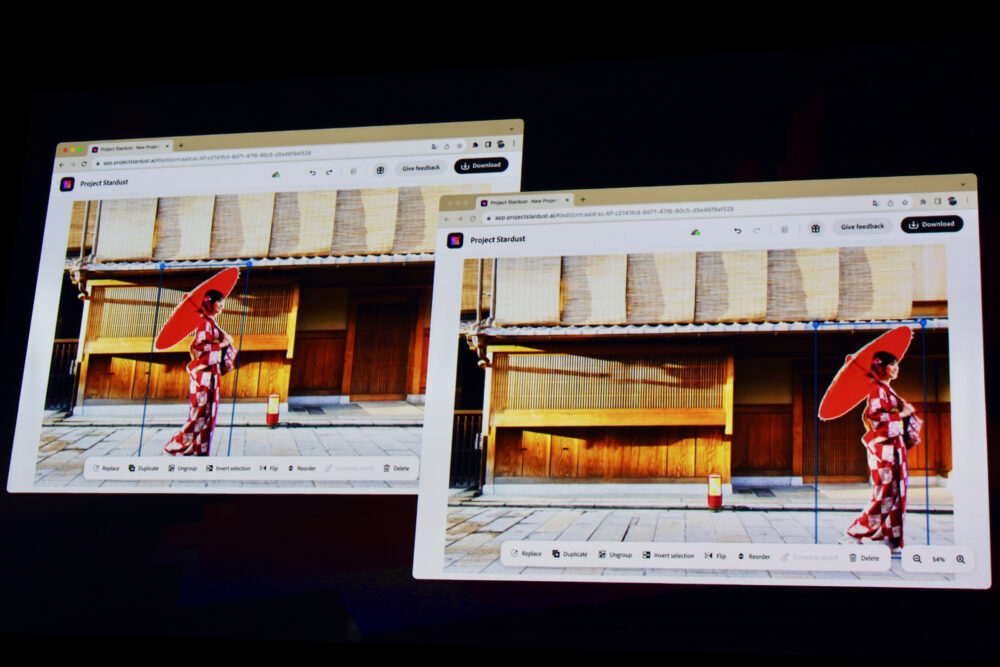

Project Stardustのデモもすごかった。下の写真を見れば一目瞭然。京町家の前を歩く着物の女性を移動させることができる。つまり、遠近を把握して女性をキリヌキし、移動させたあとに、女性のいた場所の背景を自動生成できるのだ。

遠近も把握しているので、歩いている人の重なり具合の前後関係を変更したり、位置を替えたりと自由な編集が可能になるのだ。

しかし、こうなってくると我々メディアの『写真』に対する感覚もアップデートせざるを得ないといえるだろう。

たとえば、広告写真や雑誌の特集タイトルカットで、特定のイメージを作るために編集することはあるだろうけれど、この記事のようなレポート記事での編集はどのぐらい許されるのだろうか?

読者の方は当然『許されない』と思われるだろうけれど、我々の記事でも主題を強調するために余計なものを写真のフレームに入れないことは当たり前だし、望遠レンズや絞りを開ける明るいレンズを使って、奥や手前の余計なものをボカすのは当たり前の方法論だ。しかし、それを『撮影後』にするのは、どのぐらい許されることなのだろうか? このあたりの常識も、今後変わっていくものと思われる。

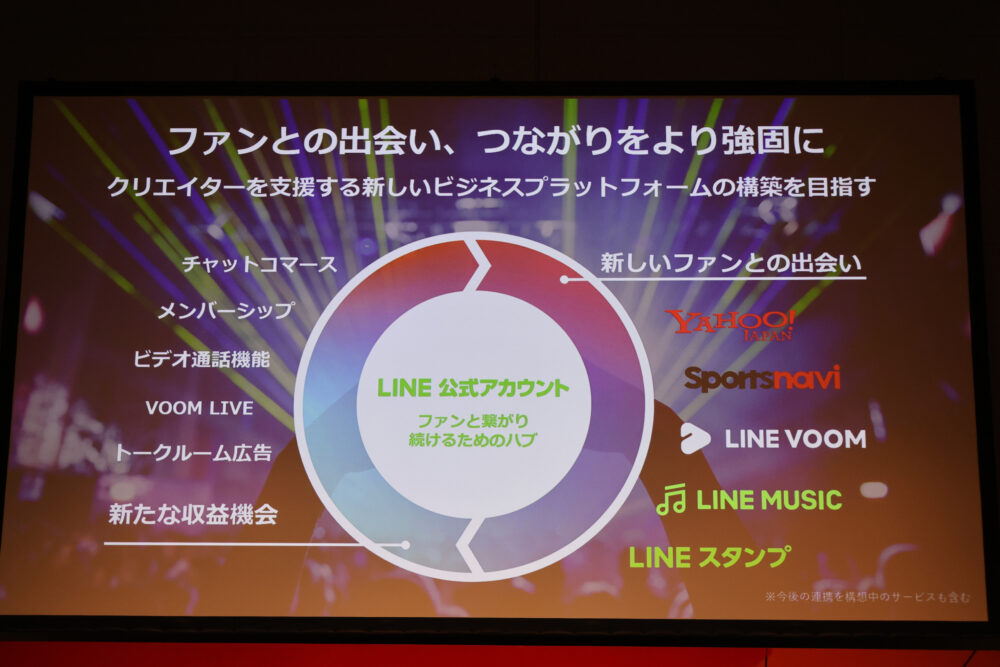

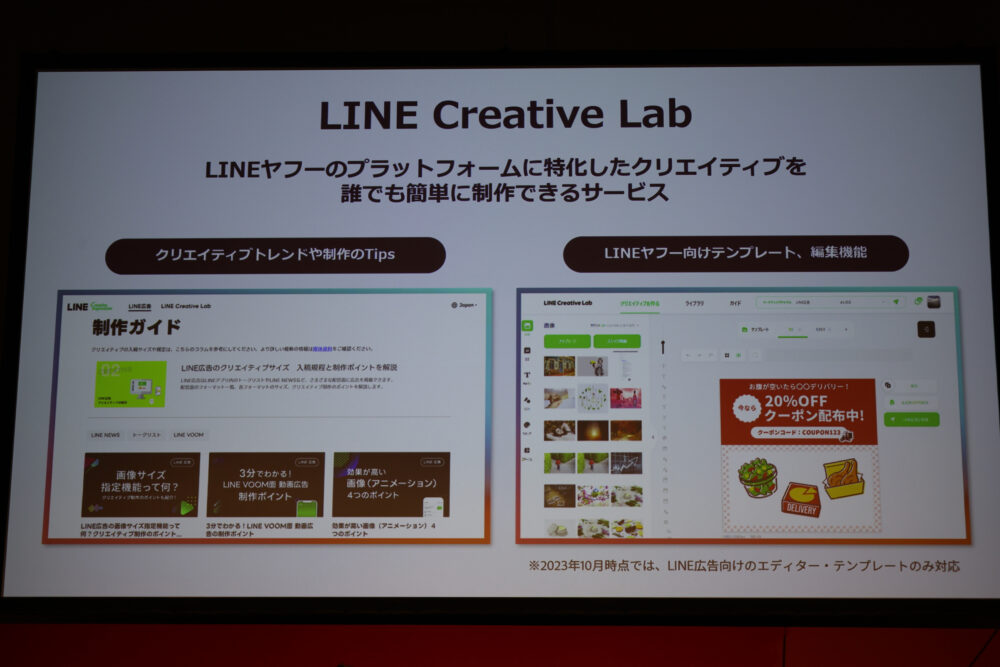

ちょっと驚きの発表だったのが、LINEヤフーやnoteとの提携だ。どちらもAdobe Expressを、それぞれのサービスから呼び出せるというカタチでの提携なのだが、アドビのクリエイティブ系のサービスがこんなにダイレクトに他社サービスと繋がった例を筆者はあまり覚えていないので、驚いた。たとえば、LINEスタンプを作ろうとしたらAdobe Expressが呼び出されるとか、noteの見出し画像を作るのに、Adobe Express経由でAdobe Fireflyの生成AI機能を利用できる、というカタチだ。

「海外でもこういう事例はあるのか? 日本が初めてなのか?」と質問したところ、海外でも事例があるということなので、全世界的な方針のようだ。Adobe CCがクリエイターに普及し切ったところではあるが、『月額6480円を使ってCCを使える人と、使えない人』に世界が分断されていることを考えると、「すべての人に『つくる力』を」というAdobeの方針を推進するために、Adobe Expressを広く広く提供していこうという姿勢は好感が持てる。

ソフトウェアサービスの世界において、○○Expressとか、○○Essentialとかいうサービスが収益性を持って継続された例をあまり知らないのだが、今度こそ生成AIという武器を持ってうまく使い方に熟達したユーザー以外にも普及して、成功して欲しいと思う。

『貂明朝アンチック』というマンガ用のフォントが発表されたが、これについてはとても面白いと思うので、別途記事を書こうと思っているため、ここでは割愛する。

その他、Sneak Previewとして、Adobe Sensei GenAIを使って、動画の音声、BGM、観衆の声などを切り分け、それぞれに個別にエフェクトをかけたりできるProject Sound Lift、生成塗りつぶしを動画で行うProject First Fill(動画から、電柱を消したり、人の顔からマスクを消したりできる(ホンマか!?))、などの技術が発表された。いずれも魔法のような技術だが、近いうちに実現するのかもしれない。

多くの人に、アドビのクリエイティブパフォーマンスを

Adobe MAXの話は非常に興味深いのだが、専門的に話せば話すほど『アドビの先進技術を知っていて情報収集しているプロ』向きの話になってしまうので、なるべく一般の人に理解してもらえるように書いたつもりだが、いかがだったろうか?

特に、筆者の周りのクリエイターの人たちは、先進技術には興味のない人も多く、10年も前のMacを使って、プチプチとキリヌキのパスを手作業で切っている職人肌の人もいっぱいいる。Adobeの最新技術が、そういう人はもちろん、一般の「クリエイティブなんて関係ない」と思っている人にも届いたらいいなと思う。生成AIの技術はそういうことを実現する可能性もあると思うのだ。

(村上タクタ)

関連する記事

-

- 2026.05.14

Notta Brainの本質は、文字起こしではなく『記憶の検索』だった

-

- 2026.04.29

アドビのフォントデザイナーは一子相伝!? 三代目が作った『ネオクロ』に注目

-

- 2026.04.24

アプリで作る、ペットボトルゴミのない世界【mymizu:Today at Apple】

-

- 2026.01.31

取材の文字起こしに、Nottaが欠かせなくなっている

![Dig-it [ディグ・イット]](https://dig-it.media/wp-content/uploads/2022/09/dig-it-1-1.png)