公開された『ライブ翻訳(ベータ版)』はかなり使える機能

なにはともあれ、AirPodsを使ったライブ翻訳。これまでの英語、スペイン語、フランス語、ドイツ語、ポルトガル語に加えて、中国語(簡体字および繁体字)、日本語、韓国語、イタリア語が追加された。筆者は、アップル本社でのiPhone発表会の時に日本語対応のベータ版を体験させてもらっていたが、その時よりも翻訳精度は大きく上がって、発話もなめらかに感じた(仕様の違いは公開されていないので、個人の感想の域を出ないが)。

まずは、ライブ翻訳を利用出来る条件を確認しておこう。

iPhoneはApple Intelligenceを利用できるモデル(iPhone 15 Pro、iPhone 16以降)であること。Apple Intelligenceがオンになっている必要がある。AirPodsは、AirPods 4、AirPods Pro 2以降が対応。最新のAirPods Pro 3でなくても対応していることに注意しておきたい。そして、当然最新のiPhoneをiOS 26.1以降、AirPodsのドライバをバージョン8A356以降にアップデートしておく必要がある。

続いて、『翻訳』アプリで対象言語をダウンロードする。これで準備完了だ。

あとは、AirPodsを耳に装着して、翻訳アプリを『ライブ』タブに切り換え、『相手の言語』『あなたの言語』を設定して『翻訳を開始』をタップすればいい。

身近に日本語以外の言語の話者がいなかったので、iPhone発表会の基調講演の動画を聞いてみたが、かなりの精度で翻訳してくれる。しかも翻訳言語の発話もスムーズ。完全とは言えないが、基調講演の内容がしっかり分かる。iPhone発表会の時に非公開のベータ版を試させてもらった時よりかなりスムーズになっていたので驚いた。

これなら、双方が『ライブ翻訳』を持っていて、コミュニケーションを取りたいと思っている状態なら十分に会話が成立すると思う。

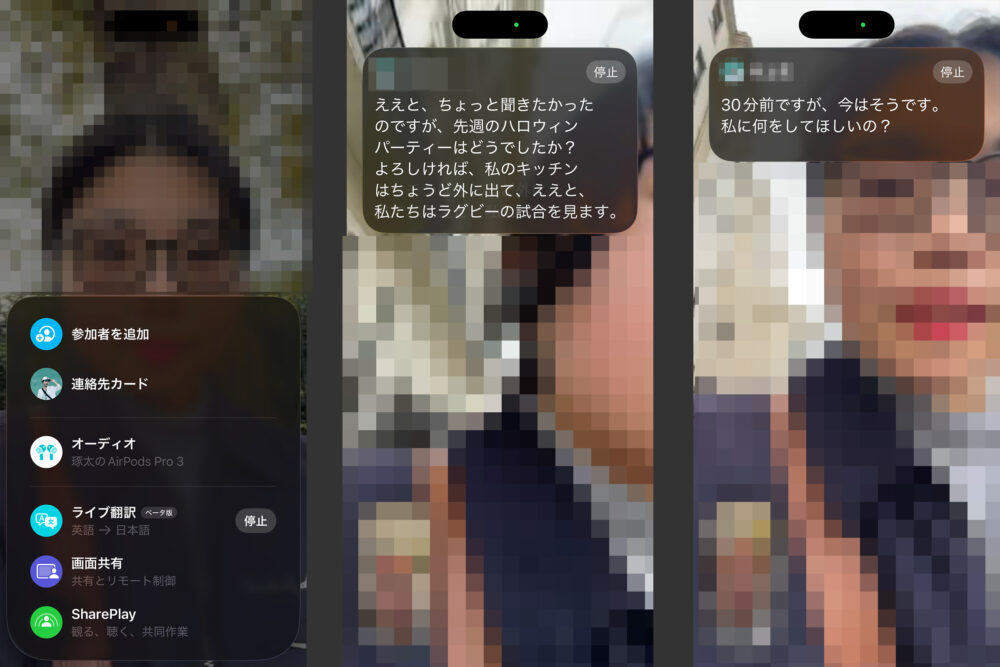

互いに『ライブ翻訳』を準備している状況でなければ、こちらの音声は、ご覧のような感じで自分のiPhoneに表示されるので、これを相手に見せてもいいし、再生ボタンを押したら、音声で再生もしてくれる。この言語モデルはiPhoneにダウンロードされているので、オフラインでも動作するから、飛行機の中など回線が通じない場所でも利用できる。

前にもご説明したが、日本語は英語と語順が違うので、どうしても一文が終わってから翻訳されるからテンポが遅れるという問題があるが、それを除いてはかなりの精度で翻訳してくれる。会話になるかどうかは、相手がどのぐらい積極的に対応してくれるかにもよると思うが、『翻訳アプリを介しての会話』に相手が慣れてくれれば、利用範囲は広がると思う。

ただ、AirPodsは相手の元の音声の音量を下げて、翻訳した音声を大きく伝えてくるので、相手の言語(ここでは英語)は把握しにくくなる。自分の脳は完全に日本語の方を追いかけてしまう。そうなると、英語で返事をするのは難しいので、返事もiPhoneに頼ることになってしまう。カタコトでもリアルにコミュニケーションした方がいい状況というのはありそうだ。

また、このテキストデータを保存できると、筆者的にはかなり便利……と思ったが、このテキストは取り出せない模様。会話を終了させるまでに画面キャプチャを撮って文字認識させるしかなさそう。個人的には、ぜひテキストの保存機能を付けて欲しい(取材のために(笑))。

しかし、自身が完全に学習していない言語、たとえば筆者の場合なら、中国語とか、ドイツ語、スペイン語だと、最初から『ライブ翻訳』に頼るしかないわけだから、そういう状況ではかなり役に立ちそう。英語が堪能な人も旅先などでこの機能を使う可能性もあるということだ。

FaceTimeでの翻訳精度は低かった

次に、FaceTimeでの翻訳を試してみた。これは、英語に堪能な娘に英語で話してもらって、それを翻訳してみたのだが、こちらの方はだいぶ精度が低かった。元となる声の音質の問題か、それとも利用している言語モデルが違うのか、ちょっと分からないが、ご覧のように会話は通じにくかった。

というわけで、ライブ翻訳はリアルに会話する時にはけっこう使えるけど、通話(少なくともFaceTime通話)の翻訳は難しいというのが私の感想だ。

Liquid Glassの視認性を向上させるオプションなど多くの新機能

その他にも、さまざまなアップデートが行われている。

Liquid Glassの見え方は調整可能になった。透明度を下げて見やすくするか、それともガラスのようにクリアな表示にするかを選択できる。

筆者はLiquid Glassのユニークな表現をとても気に入っているが、「見にくくなった」という声もある。そういう人のために選択肢が用意されたというわけだ。

また、カメラに関しても細かい設定変更が可能となった。ロック画面をスワイプしてカメラを起動する動作のオン・オフをユーザーが選べるようになっており、「うっかりスワイプしてカメラが起動してしまう」ことを防ぐことができる。

録音機能の面でもアップデートが行われている。外部USBマイクを接続して録音する場合、ゲイン(音量)を直接制御できるようになった。また、収録した音声ファイルの保存場所も指定できるようになり、ポッドキャストやフィールドレコーディングを行うユーザーにとって、実用的な改善といえる。

あと、これは今回のアップデートなのか、筆者はちょっと自信がないのだが、メールやメッセージ、写真などから、スケジュールを登録できるようになっていた。写真の文字認識で日時を見つけるとキャプチャの選択画面の下に『カレンダーに追加』という選択肢が出てくる。これを選択するとワンタップでスケジュールが登録できる。

Facebook Messageなどでスケジュールの調整をすることが多い筆者にとってはかなり便利な機能だ。

名刺などの住所・氏名の写真を撮ると連絡先アプリに登録してくれるようになるとかなり便利なのだが……そちらは対応していない模様。残念。

とはいえ、Apple Intelligenceがいろいろ日常的に便利に使えるようになってきた。iPhone 15 以前のモデルを使ってる人も、次はApple Intelligence対応モデルに買い替えた方が良さそうだ。

(村上タクタ)

関連する記事

-

- 2026.03.10

唯一の10万円切りiPhone 17eの進化点と注意点【先行レビュー】

![Dig-it [ディグ・イット]](https://dig-it.media/wp-content/uploads/2022/09/dig-it-1-1.png)